Image Classification

- Image Classification: 컴퓨터 비전 분야에서 대중적인 task

- Architecture: Backbone (CNN) + Classification head (FC Layer)

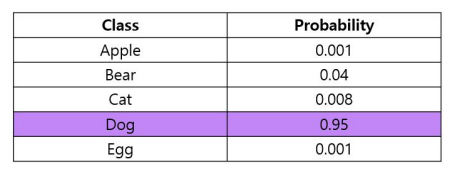

- Logits & Softmax

- Logits: 각 클래스에 대한 예측을 수치(실수값)로 나타내는 중간 단계

- Softmax 함수는 실수 전체의 범위를 가지는 logits을 지수 함수를 사용하여 클래스 간의 상대적 확률 (0 ~ 1 사이의 값) 계산 - Data-driven 방식으로 큰 성공을 거둔 컴퓨터 비전 태스크 중 하나

- Dataset

- MNIST

- 0부터 9까지 10개의 클래스 이루어진 숫자 모음

- 28 x 28 grayscale 이미지

- 60k 학습 데이터

- 10k 테스트 데이터

- CIFAR10

- 10개의 클래스 이루어진 사물 및 동물 모음

- 32 x 32 RGB 이미지

- 50k 학습 데이터

- 10k 테스트 데이터

- ImageNet

- 1000개의 클래스 이루어진 사물 및 동물 모음

- 평균 469x387 RGB 이미지

- 전처리 이후, 일반적으로 256x256 RGB 이미지로 통일

- 최대 ~1.2M 학습 데이터

- 100k 테스트 데이터 - Training Process

- Preprocessing

- Model

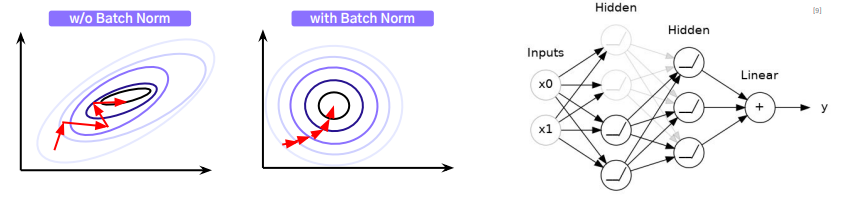

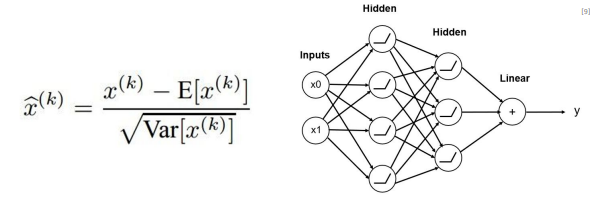

- 학습 안정성을 증대시키는 방법: Batch Normalization(입력데이터의 평균과 분산 계산), Dropout(뉴런 제외 확률 설정)

- Softmax Classifier의 목적: 입력에 대한 클래스별 확률 분포 생성 및 모델을 학습시키는 데 사용

- Loss

- Loss function: 실제 class와 예측한 class의 차이를 줄이기 위해 사용

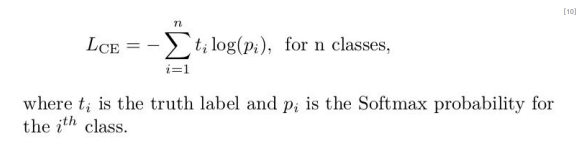

- Cross-entropy loss를 이용해 loss function을 정의

- Test Process

- Preprocessing

- Model

- 효과적 모델 사용법: Batch Normalization(학습 시 구한 평균과 분산 running mean 이용), Dropout(뉴런 전체 이용)

- Softmax classifier의 목적: 새로운 입력 데이터에 대한 클래스별 확률을 예측

- Prediction

- Prediction: 학습된 Model의 결과물로, 해당 이미지가 어떤 클래스인지 예측

- Softmax Classifier의 output 중 가장 큰 값

- Metric

- 모델이 잘 학습되었는지 판별하기 위해, 정량적인 평가로 Accuracy와 Precision Metric을 이용

'Study > 컴퓨터비전 CV' 카테고리의 다른 글

| Semantic Segmentation (0) | 2025.01.03 |

|---|---|

| Object Detection (1) | 2025.01.03 |

| CNN (1) | 2025.01.03 |

| 컴퓨터 비전 모델 구조 (2) | 2024.12.23 |

| Computer Vision-고전 컴퓨터 비전 (0) | 2024.12.23 |